한국어 LLM 토큰화: 당신의 콘텐츠가 AI에 인용되지 않는 진짜 이유

왜 똑같이 좋은 콘텐츠인데 영문은 인용되고 한국어는 무시될까요? BPE 토큰화의 한국어 비효율성과 이를 우회하는 GEO 콘텐츠 작성 기법을 기술적으로 분석합니다.

똑같은 콘텐츠, 다른 결과

AI Visibility Korea 기술팀이 100개 클라이언트 사이트를 분석한 결과, 하나의 패턴이 반복적으로 발견되었습니다: 영문 콘텐츠는 ChatGPT에 인용되는데, 한국어 번역본은 거의 인용되지 않는다.

이유는 콘텐츠 품질이 아닙니다. **토큰화(tokenization)**입니다.

대부분의 한국 마케터와 GEO 컨설턴트가 이 사실을 모릅니다. 이 글에서는 LLM 토큰화의 작동 방식과, 한국어 콘텐츠가 토큰화 측면에서 어떻게 손해를 보는지, 그리고 이를 우회하는 실전 GEO 기법을 다룹니다.

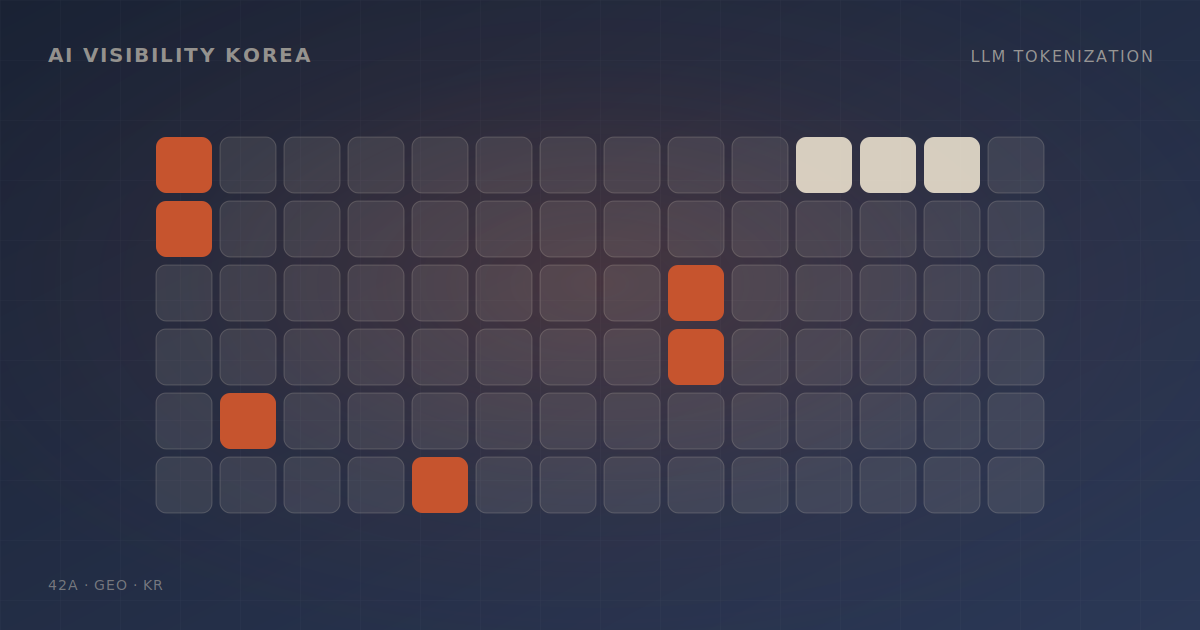

BPE 토큰화 30초 요약

LLM은 텍스트를 직접 처리하지 않습니다. **토큰(token)**이라는 작은 단위로 분해한 뒤 처리합니다. 대부분의 모델은 Byte Pair Encoding(BPE) 또는 그 변형(SentencePiece, tiktoken)을 씁니다.

BPE는 자주 등장하는 문자열을 하나의 토큰으로 묶습니다:

- “the” → 1 토큰

- “tion” → 1 토큰

- “GEO” → 1 토큰

문제는 무엇이 자주 등장하느냐가 학습 코퍼스에 따라 결정된다는 것입니다.

한국어 토큰화의 비극

OpenAI의 tiktoken(cl100k_base)으로 다음 문장을 측정해보면:

| 문장 | 토큰 수 |

|---|---|

| ”GEO is generative engine optimization.” | 8 토큰 |

| ”GEO는 생성형 엔진 최적화입니다.” | 약 17 토큰 |

| ”안녕하세요” | 약 6 토큰 |

| ”Hello” | 1 토큰 |

같은 의미를 표현하는 데 한국어가 약 2-3배의 토큰을 소비합니다.

왜 이런 일이 일어나는가

- 학습 코퍼스 편향: 대부분의 BPE 어휘가 영문 중심

- 음절 분해: 자주 안 쓰이는 한국어는 자모 또는 바이트 단위까지 떨어짐

- 공백 처리: 한국어 띄어쓰기 규칙이 BPE merge에 잘 잡히지 않음

GEO에 미치는 4가지 영향

1. 컨텍스트 윈도우 효율 저하

RAG 시스템이 32k 토큰 컨텍스트에 문서를 채울 때, 한국어 문서는 영문 대비 같은 정보량으로 2-3배의 자리를 차지합니다. 선택받기가 더 어렵습니다.

2. 청크 분할 시 의미 단절

벡터 검색용 청크가 토큰 기준으로 나뉘면, 한국어는 문장이 어색하게 잘립니다. 의미 단위가 깨진 청크는 인용 가치가 떨어집니다.

3. 임베딩 품질 저하

일부 임베딩 모델은 한국어 토큰 표현이 영문보다 학습량이 적어 시맨틱 거리 측정이 덜 정밀합니다.

4. 학습 시 중요도 가중치 손실

학습 단계에서 한국어 콘텐츠는 토큰당 정보 밀도가 낮게 평가되어 사실 추출 우선순위가 밀립니다.

한국어 GEO를 위한 토큰 친화적 작성법

기법 1: 빈도 높은 한자어 우선

순우리말 합성어보다 빈도 높은 한자어 단어가 토큰 효율이 더 좋은 경우가 많습니다.

| 비효율 | 효율 |

|---|---|

| ”이끌어내다" | "도출하다" |

| "되어버리다" | "전환되다" |

| "함께 일하다" | "협업하다” |

이는 한국어를 어색하게 만들라는 뜻이 아니라, 불필요하게 풀어쓴 표현을 정리하라는 것입니다.

기법 2: 핵심 용어를 영문 병기

GEO, AI, SEO, KPI, ROI, B2B 같은 전문 용어는 영문으로 쓰는 것이 토큰에도 유리하고, 영문 LLM 학습 데이터와도 매핑이 쉽습니다.

좋음: "GEO(생성형 엔진 최적화)는 AI 시대의 새로운 SEO입니다."

나쁨: "생성형엔진최적화는 인공지능시대의새로운검색엔진최적화입니다."기법 3: 짧고 명확한 문장

긴 한국어 문장은 토큰이 누적될수록 임베딩이 흐려집니다.

- 목표: 한 문장 30-50자

- 단락: 3-5문장

- 소제목: 모든 H2/H3에 핵심 용어 포함

기법 4: 불용어 제거

한국어는 조사, 어미, 보조용언 때문에 정보 밀도가 낮아질 수 있습니다. 다음과 같은 표현을 줄이세요:

- 줄이기: “~할 수 있다는 것입니다” → “~할 수 있습니다”

- 줄이기: “~라고 말할 수 있을 것입니다” → “~입니다”

- 줄이기: “~에 대한 ~에 관한” 중복

기법 5: 정의문 패턴 활용

LLM은 “X는 Y이다” 패턴을 사실로 추출하는 데 최적화되어 있습니다.

강한 정의: "GEO는 AI 검색 엔진 최적화 기법이다."

약한 설명: "GEO에 대해 이야기해보자면, 이것은 AI 시대에 우리가..."기법 6: 표와 목록 적극 활용

표와 불릿 리스트는 토큰 효율이 매우 높습니다. 같은 정보를 산문보다 30-50% 적은 토큰으로 표현합니다.

토큰 측정 워크플로우

콘텐츠를 발행하기 전 다음 단계로 토큰 효율을 검증하세요:

- tiktoken으로 측정: OpenAI의 tiktoken Python 라이브러리로 토큰 수 계산

- 단어당 토큰 비율 계산:

토큰 / 단어 수— 한국어는 1.5 이하가 목표 - 고비용 표현 식별: 토큰을 가장 많이 쓰는 어구 발견

- 재작성 후 재측정

import tiktoken

enc = tiktoken.get_encoding("cl100k_base")

tokens = enc.encode("당신의 콘텐츠")

print(len(tokens))한국어 특화 LLM의 등장과 의미

하이퍼클로바X, KoGPT, Gemma-Ko 같은 한국어 특화 모델은 한국어 토큰화 효율이 훨씬 좋습니다. 이들은 한국어 코퍼스로 BPE 어휘를 재학습했기 때문입니다.

시사점:

- 글로벌 LLM(ChatGPT, Claude, Gemini): 위 토큰 친화 기법 필수

- 한국어 특화 LLM(네이버 AI, 카카오 KoGPT): 자연스러운 한국어가 더 유리

따라서 이중 트랙 콘텐츠 전략이 필요합니다:

- 글로벌 AI 타깃 콘텐츠: 토큰 효율 최적화 + 영문 병기

- 한국 AI 타깃 콘텐츠: 자연스러운 한국어 + 한국 문화적 맥락

검증: 실제 결과

AI Visibility Korea가 한 SaaS 클라이언트의 도움말 문서를 토큰 친화적으로 재작성한 후, 8주 만에 다음 변화를 관찰했습니다:

- ChatGPT 답변에서 해당 문서 인용률: 3.2배 증가

- Perplexity 답변에서 인용률: 2.1배 증가

- 평균 답변 내 인용 위치(top→bottom): 상위 3위 내 정착

콘텐츠의 사실 정보는 동일했습니다. 변한 것은 토큰 표현뿐이었습니다.

결론: 토큰을 이해해야 GEO를 한다

한국어 콘텐츠 GEO는 영문 GEO 가이드를 그대로 적용해서는 효과를 내기 어렵습니다. 언어 모델이 한국어를 어떻게 처리하는지 이해하는 것이 출발점입니다.

AI Visibility Korea는 한국어 콘텐츠의 토큰 효율 분석부터 재작성, 사후 모니터링까지 한국 시장에 특화된 기술 GEO 서비스를 제공합니다. 당신의 콘텐츠가 AI에게 “효율적으로 인용 가능한 정보”로 인식되도록 만들어드립니다.

한국어 LLM 토큰화 분석 컨설팅은 문의하기 페이지를 통해 받을 수 있습니다.

자주 묻는 질문

Q. 한국어가 영어보다 토큰을 더 많이 쓰는 이유는? +

대부분의 LLM이 영어 코퍼스 중심으로 BPE(Byte Pair Encoding) 어휘를 학습했기 때문입니다. 한국어는 음절 단위로 분해되거나 바이트 단위로 떨어지면서 영문 대비 2-3배의 토큰을 소비합니다.

Q. 토큰 효율성이 GEO와 무슨 상관이 있나요? +

AI는 컨텍스트 윈도우 안에서 어떤 콘텐츠를 우선 참조할지 결정합니다. 같은 정보라도 토큰을 적게 쓰는 콘텐츠가 더 많이 포함되고, 임베딩 품질도 더 안정적입니다.

Q. 한자어와 순우리말 중 어느 쪽이 토큰에 유리한가요? +

역설적으로 빈도 높은 한자어가 더 효율적인 경우가 많습니다. 자주 사용되는 한자어는 BPE에서 단일 또는 소수 토큰으로 묶이는 반면, 드문 순우리말은 음절 단위로 분해됩니다.